在當今大數據技術生態中,HBase作為一款高性能、高可靠、面向列的分布式NoSQL數據庫,已成為企業處理海量非結構化或半結構化數據的關鍵技術棧。無論是數據工程師、數據開發還是大數據架構師的面試中,對HBase的深入理解往往是考察的重點。本文將從核心概念、數據處理與存儲支持服務等維度,系統解析HBase的技術精髓。

一、HBase的核心定位與架構

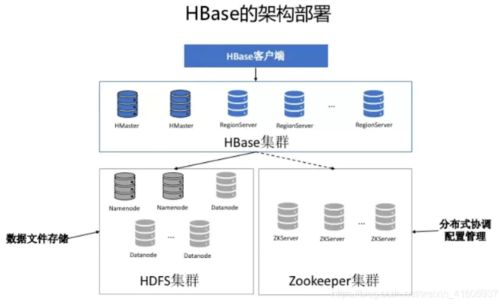

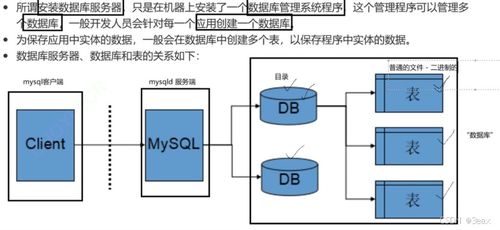

HBase構建在Hadoop HDFS之上,專為處理大規模數據集而生。它本質上是一個稀疏的、分布式、持久化的多維排序映射表,通過行鍵(Row Key)、列族(Column Family)、列限定符(Column Qualifier)和時間戳(Timestamp)四個維度來定位數據。其架構主要包括以下幾個核心組件:

1. HMaster:負責RegionServer的負載均衡、Region的分配與遷移,以及DDL操作(如表創建、刪除)。

2. RegionServer:負責具體的數據讀寫請求,管理多個Region。

3. Region:HBase中數據分布和負載均衡的基本單位,一個表在水平方向上被劃分為一個或多個Region。

4. ZooKeeper:作為協調服務,負責維護集群狀態、實現HMaster的高可用以及存儲元數據位置。

這種架構確保了HBase具備線性擴展能力,能夠通過簡單增加機器來應對數據量和訪問量的增長。

二、HBase的數據處理能力

HBase的數據處理能力是其核心價值之一,主要體現在高效的讀寫操作上。

- 寫入優化:HBase采用LSM-Tree(日志結構合并樹)作為其底層存儲模型。數據首先寫入內存中的MemStore,當達到一定閾值后,異步刷寫到磁盤形成不可變的HFile。這種順序寫入方式極大地提升了寫入吞吐量,非常適合寫密集型的場景。

- 讀取優化:讀取數據時,系統會同時查詢MemStore和多個HFile,并通過布隆過濾器(Bloom Filter)和塊緩存(BlockCache)來加速查詢。布隆過濾器可以快速判斷某個數據塊中是否包含目標行鍵,避免了不必要的磁盤I/O。

- 強一致性模型:在單個行鍵的維度上,HBase提供強一致性讀寫,所有客戶端看到的同一行數據順序是一致的。

- 豐富的API:除了傳統的Put、Get、Scan、Delete操作,HBase還支持通過協處理器(Coprocessor)實現服務端計算,如自定義過濾器、聚合操作等,將計算邏輯推送到數據所在服務器,減少網絡傳輸開銷。

三、HBase的存儲支持服務

HBase的強大離不開其背后穩固的存儲支持服務,這確保了數據的持久性、可靠性與可管理性。

- 基于HDFS的持久化存儲:HFile最終存儲在HDFS上,天然繼承了HDFS的高可靠、高容錯特性。數據默認多副本存儲,硬件故障不會導致數據丟失。

- Region的自動分片與負載均衡:隨著數據增長,Region會自動分裂。HMaster會監控RegionServer的負載情況,將Region在集群內重新分布,以實現負載均衡,保證集群性能穩定。

- 數據壓縮與編碼:HBase支持對HFile進行多種算法(如GZ、LZO、Snappy)的壓縮,以及對數據進行前綴編碼、差分編碼等,有效節約存儲空間,提升I/O效率。

- 完善的運維與監控:HBase提供了豐富的Shell命令、Web UI以及與JMX的集成,方便管理員進行集群管理、狀態監控和性能調優。其與Hadoop生態的深度集成,也使得數據導入導出(如通過Spark、Flink、Sqoop)非常便捷。

四、典型應用場景與面試要點

HBase非常適合需要隨機、實時讀寫訪問超大規模數據集的場景,例如:

- 用戶畫像與推薦系統:存儲和快速查詢用戶行為、屬性標簽。

- 時序數據:存儲物聯網傳感器數據、監控指標。

- 消息通信:存儲在線消息、郵件數據。

- 作為大數據平臺的查詢結果集緩存。

在面試中,除了上述原理,候選人還需準備:

- RowKey設計原則(散列、有序、長度),這是影響性能的關鍵。

- HBase與RDBMS、Hive、Cassandra等的對比。

- 讀寫流程的詳細步驟(如一次Put操作如何最終落盤)。

- Compaction(合并)機制的作用與類型(Minor/Major)。

- 如何排查和解決熱點Region問題。

HBase以其卓越的擴展性、靈活的數據模型和強大的實時讀寫能力,在大數據存儲領域占據著不可替代的地位。深入理解其數據處理邏輯和存儲支持服務,不僅能幫助開發者和架構師更好地駕馭這項技術,也是在大數據面試中脫穎而出的重要籌碼。